A lineáris regresszió egy függő változó és egy vagy több magyarázó változó közötti kapcsolat magyarázatára szolgál egy egyenes segítségével. Ez a regresszióelemzés egy speciális esete.

A lineáris regresszió volt az első olyan regresszióelemzési típus, amelyet szigorúan tanulmányoztak. Ennek oka, hogy az ismeretlen paramétereiktől lineárisan függő modelleket könnyebb illeszteni, mint a paramétereikhez nem lineárisan kapcsolódó modelleket. Ráadásul az így kapott becslők statisztikai tulajdonságai is könnyebben meghatározhatók.

A lineáris regressziónak számos gyakorlati alkalmazása van. A legtöbb alkalmazás a következő két nagy kategória egyikébe sorolható:

- A lineáris regresszió arra használható, hogy előrejelző modellt illesszünk a megfigyelt értékek (adatok) halmazához. Ez akkor hasznos, ha a cél előrejelzés vagy becslés. Egy ilyen modell kidolgozása után, ha ezután X egy további értékét adjuk meg, a hozzá tartozó y érték nélkül, az illesztett modell felhasználható az y értékének előrejelzésére.

- Adott egy y változó és számos olyan X1, ..., Xp változó, amely kapcsolatban állhat y-val, a lineáris regresszióanalízis alkalmazható az y és az Xj közötti kapcsolat erősségének számszerűsítésére, annak felmérésére, hogy mely Xj-nek nincs kapcsolata y-val, és annak azonosítására, hogy az Xj-ek mely részhalmazai tartalmaznak redundáns információt y-ról.

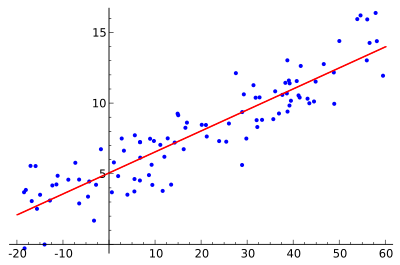

A lineáris regressziós modellek arra törekednek, hogy az egyenes és az adatpontok (pl. a reziduumok) közötti függőleges távolság a lehető legkisebb legyen. Ezt nevezik "a vonal adatokhoz való illesztésének". A lineáris regressziós modellek gyakran a maradékok négyzeteinek összegét próbálják minimalizálni (legkisebb négyzetek), de az illesztésnek más módjai is léteznek. Ezek közé tartozik az "illeszkedés hiányának" minimalizálása valamilyen más normában (mint a legkisebb abszolút eltérések regressziója esetén), vagy a legkisebb négyzetek veszteségfüggvényének büntetett változatának minimalizálása, mint a ridge-regresszióban. A legkisebb négyzetek megközelítése olyan modellek illesztésére is használható, amelyek nem lineárisak. A fentiek szerint a "legkisebb négyzetek" és a "lineáris modell" kifejezések szorosan kapcsolódnak egymáshoz, de nem szinonimák.

Alapfogalmak és matematikai forma

A legegyszerűbb, egyváltozós lineáris regresszió modellje:

y = β0 + β1 x + ε

ahol y a függő változó, x a magyarázó változó, β0 az intercept (elleny), β1 a meredekség (szorzó), és ε a véletlen hibatag (reziduum). Több magyarázó változó esetén a modell általános alakja:

y = β0 + β1 x1 + ... + βp xp + ε

A cél a paraméterek (βk) becslése úgy, hogy a modell jól leírja az adatokat és hasznos előrejelzéseket adjon.

Értelmezés és becslés (OLS)

Gyakran alkalmazott becslési eljárás a legkisebb négyzetek módszere (OLS, ordinary least squares). Az OLS olyan β-becslőket keres, amelyek minimalizálják a megfigyelt és a modell által előre jelzett értékek közötti négyzetes eltérések összegét. Ez az eljárás egyszerű, hatékony és jól értelmezhető.

Fontos statisztikai eredmény: megfelelő feltételek mellett (lineáris modell, független hibák, nulla várható értékű hibák, az X változók nem determinisztikusan kollineárisak) az OLS-becslők torzítatlanok és a lineáris, torzítatlan becslők között a legkisebb varianciájúak (Gauss–Markov tétel — a becslők BLUE-ek).

Feltételek, diagnosztika és gyakori problémák

- Lineáris kapcsolat feltételezése: a modell feltételezi, hogy a magyarázó változók lineáris kombinációja hat a céltényezőre. Ha nem lineáris a kapcsolat, transzformációk (pl. log, négyzetgyök) vagy nemlineáris modellek szükségesek.

- Függetlenség: a reziduumnak függetlennek kell lennie; idősoroknál gyakori az autokorreláció, amit kezelni kell (pl. ARIMA, hibastruktúra modellezése).

- Homoszkedaszticitás: az OLS feltételezi, hogy a hibák konstans varianciájúak. Heteroszkedaszticitás esetén a becslők maradnak torzítatlanok, de a standard hibák és tesztek nem megbízhatóak — robusztus standard hibák vagy súlyozott legkisebb négyzetek alkalmazhatók.

- Normális eloszlás: a hibák normális eloszlása nincs feltétlenül szükség az OLS becslők torzítatlanságához, de szükséges a paraméterekre vonatkozó klasszikus hipotézisvizsgálatokhoz és konfidenciaintervallumokhoz kis minták esetén.

- Multikollinearitás: ha a magyarázó változók közt erős lineáris kapcsolat van, nő a becslők szórása, és nehéz lesz szétválasztani az egyes változók hatását. Megoldások: változóválasztás, főkomponens-analízis, ridge vagy lasso regularizáció.

Diagnosztikai eszközök

- Szórási pontdiagramok (scatter plot) a y és egyes X-ek között

- Reziduális elemzések: reziduál vs. illesztett értékek, normális Q-Q plot

- R^2 és korrigált R^2: a magyarázott variancia aránya (kismintás torzítás kompenzálva a változószámmal)

- T-próbák és F-próbák: egyéni és együttes paramétertesztek

- VIF (variance inflation factor): multikollinearitás mérése

Kiterjesztések és alternatív módszerek

- Ridge és Lasso: a legkisebb négyzetek veszteségfüggvényének büntetett változatai (regularizáció) csökkentik a túlillesztést és kezelik a multikollinearitást.

- Robusztus regresszió: a legkisebb abszolút eltérések (LAD) vagy más robusztus módszerek kevésbé érzékenyek kiugró értékekre.

- Generalizált lineáris modellek (GLM): amikor a függő változó eloszlása nem normális (pl. bináris, számláló adatok), alkalmazhatók speciális link-függvények és veszteségfüggvények.

- Nemlineáris regresszió és gépi tanulási módszerek: ha a kapcsolat bonyolultabb, döntési fák, véletlen erdők, gradiensboosting vagy neurális hálók adhatnak jobb teljesítményt.

- Idősoros modellezés: autokorrelált hibák esetén speciális idősor-módszerek szükségesek.

Gyakorlati lépések modellalkotáshoz

- Vizualizálás: ábrázold az adatokat, keresd az egyszerű kapcsolatokat és kiugró értékeket.

- Válaszd ki a jelölteket (feature engineering): transzformációk, interakciók, polinomok szükség szerint.

- Illesztés: OLS-sel vagy más módszerrel becsült modellek létrehozása.

- Diagnosztika: reziduál-elemzés, VIF, tesztek heteroszkedaszticitásra és autokorrelációra.

- Validálás: kereszt-validáció, teszt/adat felosztás, előrejelzési pontosság mérése.

- Finomítás: regularizáció, változóválasztás, esetleg más modell kiválasztása.

Gyakorlati alkalmazások

A lineáris regressziónak számos területen van szerepe, például:

- Gazdaságtan: keresleti függvények, fogyasztói magatartás, költségbecslés.

- Egészségügy: kockázati tényezők hatásának elemzése, gyógyszeradagolás hatásának becslése.

- Finanszírozás: eszközárak előrejelzése, kockázatmodellezés.

- Műszaki alkalmazások: folyamatok modellezése, minőségellenőrzés.

- Természet- és társadalomtudományok: összefüggések feltárása különböző megfigyelési adatokon.

Tippek és gyakori buktatók

- Ne keverd össze korrelációt az oksággal: egy lineáris kapcsolat nem bizonyít ok-okozati összefüggést.

- Ügyelj a kiugró értékekre és befolyásos megfigyelésekre (influential points): ezek torzíthatják az illesztést.

- Ne hagyd figyelmen kívül a modell egyszerűségét: túlkomplex modell kevésbé általánosítható.

- Használj több mérőszámot (pl. RMSE, MAE, R^2, AIC/BIC) a modell értékeléséhez.

Összefoglalva: a lineáris regresszió egy egyszerű, jól értelmezhető és gyakran hatékony eszköz az adatok közötti kapcsolat modellezésére. Ugyanakkor fontos a feltételek ellenőrzése, a diagnosztika és a megfelelő kiterjesztések alkalmazása, ha a klasszikus feltételek nem teljesülnek.