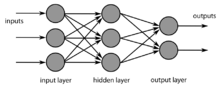

A mélytanulás (más néven mély strukturált tanulás vagy hierarchikus tanulás) a gépi tanulás egy fajtája, amelyet leginkább bizonyos típusú neurális hálózatokkal használnak. A gépi tanulás különböző megközelítéseihez hasonlóan a tanulás lehet felügyelt, felügyelet nélküli vagy félig felügyelt. A mély modellek jellegzetessége, hogy a bemeneti és kimeneti réteg között több, egymásra épülő rejtett réteg található; ezek a rétegek egymás után egyre absztraktabb, magasabb szintű jellemzőket tanulnak meg a bemeneti adatokból.

Működési elv — hogyan tanulnak a hálózatok?

A mély neurális hálózatok alapműveletei két fő fázisra bonthatók: a előre terjesztés (forward pass), amikor a bemeneti adat aktivációkat hoz létre a rétegekben, és a visszaterjesztés (backpropagation), amikor a hálózat súlyait a hibajel (loss) alapján frissítik. A hibát egy veszteségfüggvény (loss function) méri; a gradiens alapú optimalizálók (például SGD, Adam) a veszteség deriváltjai alapján állítják be a súlyokat.

A hálózatok építőelemei közé tartoznak:

- Rejtett rétegek — teljesen kapcsolt (fully connected) rétegek, konvolúciós (CNN) rétegek, rekurrens (RNN/LSTM/GRU) rétegek vagy transzformer blokk.

- Aktivációs függvények — ReLU, sigmoid, tanh, GELU stb., amelyek nemlinearitást visznek a modellbe.

- Regulárizáció — dropout, L1/L2 büntetés, korai leállítás (early stopping), batch normalization a túlilleszkedés csökkentésére és a tanulás stabilizálására.

- Speciális mechanizmusok — figyelem (attention) és önfigyelem (self-attention) a transzformerekben, illetve pooling műveletek a képfeldolgozásban.

Tanulási módok és technikák

- Felügyelt tanulás: címkézett adatokkal történő tanítás (pl. képosztályozás).

- Felügyelet nélküli tanulás: struktúra vagy jellemzők felfedezése címkék nélkül (pl. autoenkóderek, klaszterezés).

- Félig felügyelt és önfelügyelt tanulás: kevesebb címkére támaszkodó módszerek, amelyek a nagy mennyiségű nem címkézett adatból is képesek hasznos reprezentációkat tanulni.

- Transfer learning / finomhangolás: előre betanított modellek új feladatra való áthangolása, különösen hasznos kevés adathozzetel esetén.

Gyakorlati modellek és architektúrák

- Konvolúciós neurális hálózatok (CNN): elsősorban képfeldolgozásra (képosztályozás, tárgydetektálás, szegmentálás).

- Rekurzív és rekurrens hálózatok (RNN, LSTM, GRU): sorozat- és időfüggő adatok, például beszéd és időbeli jelenségek modellezésére.

- Transzformerek: nyelvi és multimodális feladatoknál uralkodó architektúra (pl. fordítás, szövegértés, nagy nyelvi modellek).

- Autoenkóderek, variációs autoenkóderek, GAN-ok: adatkódolás, generatív modellezés és adatszintézis terén fontos eszközök.

Alkalmazási területek

A mélytanulás ma sok iparágban és kutatási területen hozott áttörést. Néhány példa:

- Számítógépes látás: képfelismerés, orvosi képanalízis, arcfelismerés, tárgydetektálás.

- Beszéd és hangfeldolgozás: beszédfelismerés, beszédszintézis (TTS), hangalapú asszisztensek.

- Természetes nyelvfeldolgozás (NLP): gépi fordítás, szövegértelmezés, kérdés-válasz rendszerek, szövegösszefoglalás.

- Önvezető járművek és robotika: környezetérzékelés, döntéshozatal, mozgástervezés.

- Egészségügy és bioinformatika: betegségek korai észlelése, orvosi képek automatikus értékelése, gyógyszerjelöltek felfedezése.

- Ajánlórendszerek, pénzügyi modellezés, ipari automatizálás: személyre szabott ajánlások, kockázatbecslés, minőségellenőrzés.

Előnyök és kihívások

Előnyök:

- A mély tanulási módszerek képesek automatikusan releváns jellemzőket tanulni nyers adatokból, így gyakran jobb teljesítményt érnek el a hagyományos módszereknél.

- Nagy adatmennyiség és számítási kapacitás mellett skálázhatók, és komplex feladatokat képesek megoldani.

Kihívások:

- Adatigény: jelentős mennyiségű és jó minőségű címkézett adatra lehet szükség a kiváló eredményekhez.

- Számítási erőforrások: nagy modellek tanítása sok időt és energiát igényel (GPU/TPU szükséges lehet).

- Érthetőség és magyarázhatóság: a mély modellek gyakran „fekete dobozok”, ami nehezíti a döntések magyarázatát.

- Elfogultság és etika: ha a tanító adatok torzítottak, a modellek is torz eredményeket adhatnak.

- Adverszári fenyegetések: rosszindulatú módosításokkal könnyen félrevezethetők a modellek.

Kapcsolat a biológiával

A mélytanulási modelleket a biológiai idegrendszerek információfeldolgozási és kommunikációs mintái ihlették; ezek sok tekintetben szimbolikus inspirációt adnak. Fontos azonban kiemelni, hogy a mesterséges neurális hálózatok szerkezete és működése jelentősen eltér a valós agyak (különösen az emberi agy) biológiai részleteitől: a mesterséges modellek egyszerűsítéseket, diszkrét iteratív tanulási algoritmusokat és nagyfokú párhuzamos számítást használnak. Emiatt a jelenlegi mélytanulási megközelítések nem feltétlenül egyeztethetők össze minden idegtudományi bizonyítékkal, és a köztük lévő kapcsolat aktív kutatási terület.

Eszközök, trendek és jövő

Gyakran használt keretrendszerek: TensorFlow, PyTorch, Keras és számos magasabb szintű könyvtár. A hardveres fejlődés (GPU-k, TPU-k, dedikált gyorsítók) kulcsfontosságú a modellek gyakorlati alkalmazásához.

Jelenlegi trendek: nagy előre betanított alapmodellek (foundation models), önfelügyelt tanulás, multimodális modellek (képet és szöveget együttesen feldolgozók), modelldistilláció, kvantálás és hatékonyabb architektúrák a skálázhatóság és energiahatékonyság javítására.

Tippek kezdőknek

- Tanulj alapismereteket: lineáris algebra, valószínűségszámítás, optimalizálás és statisztika.

- Gyakorolj programozást (Python) és ismerkedj meg legalább egy mélytanulási keretrendszerrel.

- Kezdj egyszerű feladatokkal (pl. MNIST, CIFAR), majd haladj komplexebb projektek felé.

- Használj előre betanított modelleket és transfer learninget, ha kevés adated van.

- Olvass kutatási cikkeket és kövesd a közösségi forrásokat (blogok, tanfolyamok, konferenciák).

A mélytanulás dinamikusan fejlődő terület, amely jelentős hatással van a tudományra, iparra és mindennapi életre. Miközben egyre jobb teljesítményt ér el sok feladatban, fontos a módszerek korlátainak, etikai és társadalmi következményeinek ismerete és felelős alkalmazása.